Cómo calcular el error del origen en regresión lineal con Mathematica

La regresión lineal es una técnica estadística que permite encontrar la relación entre dos variables continuas. Se utiliza para predecir el valor de una variable dependiente a partir de una o más variables independientes. Una de las medidas de error más comunes en regresión lineal es el error del origen, también conocido como error de intercepto. Este error representa la distancia entre el valor real y el valor predicho por el modelo cuando todas las variables independientes son iguales a cero.

Te mostraré cómo calcular el error del origen en regresión lineal utilizando el software Mathematica. También te explicaré cómo interpretar este error y cómo utilizarlo para evaluar la calidad del modelo de regresión. Si estás interesado en hacer análisis estadísticos y quieres aprender a utilizar herramientas como Mathematica para ello, sigue leyendo.

- Cuáles son los métodos más comunes para calcular el error del origen en regresión lineal

- Cuál es la fórmula matemática para calcular el error del origen en regresión lineal

- Qué significa exactamente el error del origen en el contexto de la regresión lineal

- Cuál es la importancia del error del origen en la interpretación de los resultados de la regresión lineal

- Cuáles son las ventajas y desventajas de utilizar Mathematica para calcular el error del origen en regresión lineal

- Cuál es el proceso paso a paso para calcular el error del origen utilizando Mathematica

- Existen otras herramientas o programas que se puedan utilizar para calcular el error del origen en regresión lineal

- Preguntas frecuentes (FAQ)

Cuáles son los métodos más comunes para calcular el error del origen en regresión lineal

Existen diferentes métodos para calcular el error del origen en regresión lineal. Uno de los más comunes es el método de los mínimos cuadrados ordinarios (MCO). Este método busca minimizar la suma de los cuadrados de las diferencias entre los valores observados y los valores predichos por la línea de regresión.

Otro método utilizado es el método de máxima verosimilitud. Este método se basa en la idea de encontrar los parámetros que maximizan la probabilidad de obtener los datos observados.

Además, existe el método de los mínimos cuadrados ponderados (MCP). Este método es útil cuando los datos presentan errores heterocedásticos, es decir, cuando la varianza de los errores no es constante.

Por último, se encuentra el método de los mínimos cuadrados por segmentos (MCS). Este método divide los datos en diferentes segmentos y ajusta una línea de regresión a cada segmento.

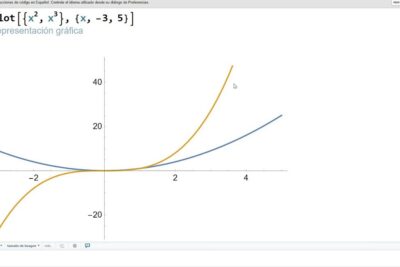

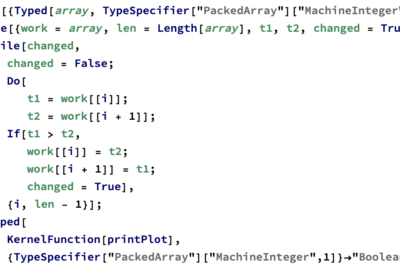

Cómo implementar estos métodos en Mathematica

En Mathematica, podemos utilizar la función Fit para calcular el error del origen utilizando el método de los mínimos cuadrados ordinarios (MCO). Simplemente debemos especificar el modelo lineal y los datos de entrada.

data = {{x1, y1}, {x2, y2}, ..., {xn, yn}};

model = a + bx;

fit = Fit;

origin_error = fit];

Para utilizar el método de máxima verosimilitud, podemos utilizar la función FindDistributionParameters. Esta función busca los parámetros que maximizan la verosimilitud de los datos.

distribution = EstimatedDistribution];

params = FindDistributionParameters;

origin_error = params];

Para implementar el método de los mínimos cuadrados ponderados, podemos utilizar la función LinearModelFit. Esta función permite especificar pesos para cada observación.

weights = {w1, w2, ..., wn};

fit = LinearModelFit;

origin_error = fit];

Finalmente, para implementar el método de los mínimos cuadrados por segmentos, podemos utilizar la función Piecewise. Esta función permite especificar diferentes modelos lineales para cada segmento de datos.

segments = {{xmin1, xmax1}, {xmin2, xmax2}, ..., {xminn, xmaxn}};

models = {model1, model2, ..., modeln};

fit = Piecewise], xmini <= x <= xmaxi}, {i, Length}]];

origin_error = fit];

Estos son solo algunos ejemplos de cómo calcular el error del origen en regresión lineal utilizando Mathematica. Dependiendo de los datos y el modelo que estemos utilizando, podemos elegir el método más adecuado.

Cuál es la fórmula matemática para calcular el error del origen en regresión lineal

Calcular el error del origen en regresión lineal es un paso fundamental para evaluar la calidad del modelo y determinar su precisión. La fórmula matemática para calcular este error se basa en la distancia entre el punto de origen y la línea de regresión. Este cálculo se realiza mediante la fórmula conocida como "Suma de los Residuos al Cuadrado" o SSRes. Esta fórmula suma el cuadrado de la diferencia entre los valores observados y los valores predichos por el modelo. Es importante tener en cuenta que un error del origen bajo indica una regresión más ajustada y precisa.

La fórmula para calcular el error del origen en regresión lineal con Mathematica es la siguiente:

error_origen = Total

Donde:

yes el valor observadomes la pendiente de la línea de regresiónxes el valor predicho por el modelones el valor del origen de la línea de regresión (intersección en el eje y)

Al calcular esta fórmula para todos los puntos de datos y sumar los residuos al cuadrado, obtendremos el error total del origen en regresión lineal.

Qué significa exactamente el error del origen en el contexto de la regresión lineal

En el contexto de la regresión lineal, el error del origen es una medida que nos indica cuánto se desvían los datos reales del punto de origen (0,0) en un gráfico de dispersión. En otras palabras, el error del origen nos muestra qué tan bien se ajusta la línea de regresión a través del origen.

El cálculo del error del origen puede ser útil para evaluar si existe un sesgo o error sistemático en nuestro modelo de regresión lineal. Si el error del origen es significativo, esto podría indicar que la línea de regresión no se ajusta correctamente a los datos y que nuestro modelo puede ser inapropiado.

Para calcular el error del origen en Mathematica, podemos utilizar la función "OriginError" que nos proporciona esta información de manera precisa y automatizada.

Cuál es la importancia del error del origen en la interpretación de los resultados de la regresión lineal

El error del origen es un término importante en la interpretación de los resultados de la regresión lineal. Este error mide la discrepancia entre los valores reales y los valores predichos por el modelo de regresión en el punto donde las variables independientes toman valor cero. Es decir, cuando todas las variables independientes son igual a cero, el modelo predice un valor para la variable dependiente, y este valor puede diferir del valor real. Por lo tanto, es importante considerar el error del origen al interpretar los resultados de la regresión lineal, ya que nos permite evaluar cómo de precisa es la estimación del modelo cuando las variables independientes son nulas.

El error del origen puede proporcionar información útil sobre el sesgo del modelo. Si el error del origen es cero, esto indica que el modelo se ajusta perfectamente a los datos cuando todas las variables independientes son nulas. Sin embargo, en la mayoría de los casos, el error del origen no es cero. Un error del origen positivo indica que el modelo sobreestima la variable dependiente cuando todas las variables independientes son igual a cero, mientras que un error del origen negativo indica que el modelo subestima la variable dependiente en esa situación.

El error del origen también puede ser utilizado para comparar modelos de regresión lineal. Si tenemos dos modelos que predicen la misma variable dependiente, pero con distintas variables independientes, podemos calcular el error del origen para cada modelo y compararlos. Si uno de los modelos tiene un error del origen más pequeño que el otro, esto indica que el primero es más preciso en la predicción de la variable dependiente cuando todas las variables independientes son cero. Por lo tanto, el error del origen puede ser utilizado como una medida de la calidad del modelo de regresión lineal.

El error del origen es un término importante en la interpretación de los resultados de la regresión lineal. Nos permite evaluar cómo de precisa es la estimación del modelo cuando todas las variables independientes son nulas y puede ser utilizado para comparar modelos de regresión lineal. Es crucial tener en cuenta el error del origen al interpretar los resultados de la regresión lineal y tomar decisiones basadas en ellos.

Cuáles son las ventajas y desventajas de utilizar Mathematica para calcular el error del origen en regresión lineal

La utilización de Mathematica para calcular el error del origen en regresión lineal presenta varias ventajas. En primer lugar, Mathematica es un software de cálculo matemático potente que permite realizar operaciones complejas de manera eficiente. Esto facilita el proceso de cálculo del error del origen, ya que Mathematica ofrece diversas funciones y herramientas especializadas en estadística.

Otra ventaja es la capacidad de Mathematica para manejar grandes cantidades de datos. Esto es especialmente útil en regresión lineal, donde es común trabajar con conjuntos de datos extensos. Mathematica permite cargar y manipular fácilmente estos conjuntos de datos, lo que hace más eficiente el proceso de cálculo.

Además, Mathematica cuenta con una amplia documentación y una gran comunidad de usuarios. Esto significa que si se encuentra con algún problema o duda durante el cálculo del error del origen, es probable que encuentre soluciones en foros o tutoriales en línea. La disponibilidad de recursos y el soporte comunitario hacen que trabajar con Mathematica sea más sencillo y eficaz en este contexto.

A pesar de estas ventajas, también existen algunas desventajas al utilizar Mathematica para calcular el error del origen en regresión lineal. Una de ellas es el costo. Mathematica es un software comercial y su licencia puede resultar costosa, lo que puede ser un obstáculo para algunos usuarios. Sin embargo, existen alternativas gratuitas como R o Python que también permiten realizar este cálculo.

Otra desventaja es la curva de aprendizaje. Mathematica es un software complejo, con muchas funciones y comandos. Esto significa que puede llevar algún tiempo familiarizarse con la sintaxis y las funciones específicas para calcular el error del origen en regresión lineal. Aquellos que no estén familiarizados con Mathematica pueden requerir más tiempo y esfuerzo para aprender a utilizarlo correctamente.

Utilizar Mathematica para calcular el error del origen en regresión lineal tiene varias ventajas, como su potencia, capacidad de manejo de grandes cantidades de datos y disponibilidad de recursos. Sin embargo, también presenta algunas desventajas, como su costo y la curva de aprendizaje. Los usuarios deben evaluar estas ventajas y desventajas antes de decidir si Mathematica es la mejor opción para sus necesidades de cálculo del error del origen en regresión lineal.

Cuál es el proceso paso a paso para calcular el error del origen utilizando Mathematica

El cálculo del error del origen en regresión lineal es importante para determinar la precisión del modelo y la relación entre las variables independientes y dependientes. Con Mathematica, puedes realizar este cálculo de manera sencilla y eficiente siguiendo estos pasos:

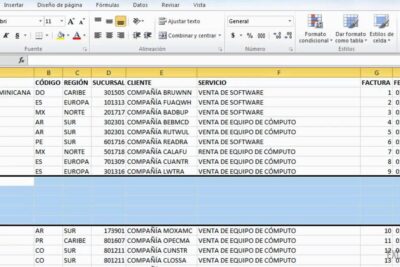

Paso 1: Importar los datos

El primer paso es importar los datos que se utilizarán para el análisis. Puedes hacer esto utilizando la función Import y especificando la ubicación del archivo o la URL del archivo de datos.

Paso 2: Ajustar el modelo

Luego, debes ajustar el modelo de regresión lineal utilizando la función LinearModelFit. Esta función te permite especificar tanto las variables independientes como las dependientes.

Paso 3: Calcular el error del origen

Una vez que hayas ajustado el modelo, puedes calcular el error del origen utilizando la función MeanPredictionBands con el parámetro "PredictionError". Esto te dará el valor del error del origen.

Paso 4: Interpretar los resultados

Finalmente, debes interpretar los resultados obtenidos. Puedes utilizar la función NormalDistribution para calcular el nivel de confianza y determinar si el error del origen es significativo o no.

Con Mathematica puedes calcular el error del origen en regresión lineal siguiendo estos pasos: importar los datos, ajustar el modelo, calcular el error del origen y finalmente interpretar los resultados obtenidos.

Existen otras herramientas o programas que se puedan utilizar para calcular el error del origen en regresión lineal

Sí, aparte de Mathematica, hay otras herramientas y programas disponibles para calcular el error del origen en la regresión lineal. Una opción popular es utilizar el lenguaje de programación R, que ofrece varias bibliotecas y funciones específicas para el cálculo de regresiones lineales y sus errores asociados.

Otra opción es utilizar Python, que también cuenta con bibliotecas como SciPy y NumPy que facilitan el cálculo de regresiones lineales y sus errores. Estas bibliotecas ofrecen funciones como "linregress" y "polyfit" que permiten calcular el error del origen.

Además, algunas aplicaciones estadísticas como SPSS y SAS también tienen funcionalidades para calcular errores de origen en regresión lineal.

Preguntas frecuentes (FAQ)

¿Qué es el error del origen en regresión lineal?

El error del origen en regresión lineal es una medida que indica cuán bien se ajusta la recta de regresión a los puntos de datos. Mide la distancia vertical promedio entre los puntos de datos y la recta de regresión.

¿Cómo se calcula el error del origen en regresión lineal con Mathematica?

En Mathematica, el error del origen se calcula utilizando la función Fit, y se obtiene el valor absoluto del coeficiente de la constante en la fórmula de ajuste lineal.

¿Qué significa un error del origen igual a cero?

Un error del origen igual a cero indica que la recta de regresión pasa por el origen (0,0) y que todos los puntos de datos se ajustan perfectamente a la recta.

¿Qué significa un error del origen negativo?

Un error del origen negativo indica que la recta de regresión está por debajo de la mayoría de los puntos de datos, lo que sugiere que el modelo de regresión subestima los valores reales.

¿Qué significa un error del origen positivo?

Un error del origen positivo indica que la recta de regresión está por encima de la mayoría de los puntos de datos, lo que sugiere que el modelo de regresión sobreestima los valores reales.

Deja una respuesta

Artículos que podrían interesarte